0 元生图成本,7 步全自动:我的 AI 配图流水线升级记

在 Obsidian 写完文章,敲一个命令,图就自己长出来了。

封面、插图、压缩、上传,全程不用切出去,不用复制粘贴,不用下载上传。

而且,全程免费(只要你有 Gemini AI Pro)。

这是我这个周末折腾出来的结果。

通过 Antigravity tool 将 Antigravity 的 Gemini 3 image 模型接出来到 Claude code中使用,调用生图 Skill 根据文章自动化生图。

上次写了 写到一半要配图?我终于让写作和配图「离婚」了,把写作和配图拆成了两个独立的 Skill。

当时我以为,拆开就完事了。

结果发现,配图这边还有一个"手动环节"卡在那里。

其实我之前就有"导演"了

先澄清一下:我不是从零开始做这个配图流程的。

之前已经有一个叫 Wechat Director 的 Skill,里面的核心人设就是"张艺谋":让 AI 像电影导演一样,给文章设计分镜。

但之前的流程是这样的:

- AI 读完文章,生成一堆图片 Prompt

- 我手动把 Prompt 复制到 Lovart

- Lovart 生成图片

- 我再把图片下载回来,插入文章

Lovart 的生图效果确实不错。但中间这个"复制粘贴"的环节,每次都让我觉得又慢又蠢。

写完一篇文章,本来心流还在,结果要切出去开网页、复制、等生成、下载、再回来插入……

这一套下来,半小时没了,心流也断了。

现在:完全自动化

这个周末,我把这个"手动环节"彻底干掉了。

现在的流程是这样的:

写完文章,敲一个 /draw 命令。

然后 AI 会:

- 通读全文,自动判断哪些地方需要配图

- 为每个位置生成对应的 Prompt

- 调用 API 直接生成图片

- 自动裁剪成标准比例

- 调用 TinyPNG 压缩体积

- 上传图床

- 自动插入文章的对应位置

从"写完"到"配图完成",全程不用切出去,不用复制粘贴,不用下载上传。

但这个"全自动",是踩了不少坑才实现的。

坑一:比例不听话

最开始,我觉得这事儿特简单。

我在 Prompt 里写得很清楚:

"请生成一张电影感封面,比例必须是 16:9。"

结果模型主打一个"选择性失聪"。不管我怎么强调,它吐出来的图经常还是正方形的。

在微信公众号的列表页,一张正方形的图会被强制拉伸或者留白,丑得没法看。

解法:光靠 Prompt 喊不醒装睡的模型。

我在代码层做了"动态模型路由"。如果要生成封面,脚本就自动去调专门的宽屏模型;如果要生成竖屏插图,就调另一个模型。

代码比咒语好使。

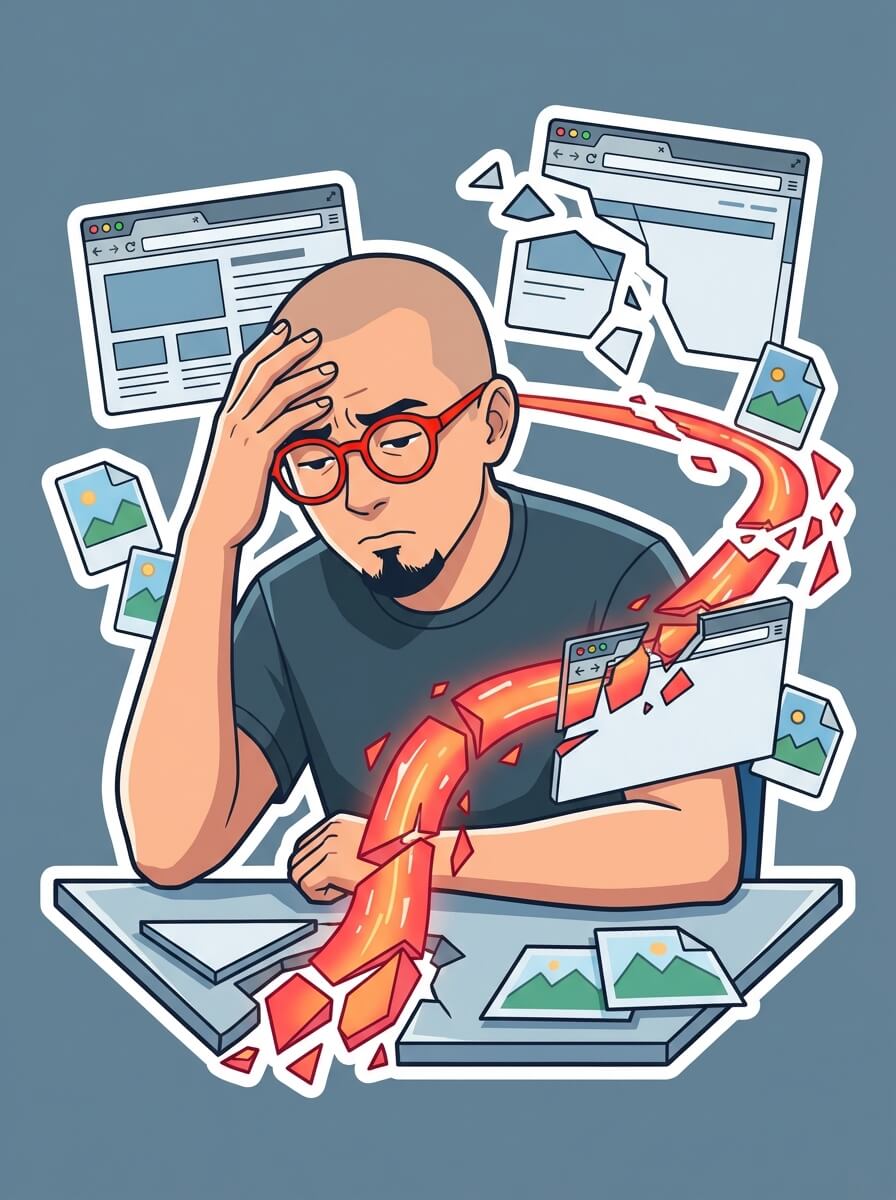

坑二:无头骑士

解决了比例问题,又来了个更尴尬的。

有时候模型还是会生成一些奇怪尺寸的图,特别是封面图需要 2:35:1 的比例。为了实现这个需要,我让 AI 写了一段代码,强制把图片裁剪成标准比例。

最开始用的是"居中裁剪"。

结果跑测试的时候,我一看生成的图,吓了一跳:

画面里的 IP 角色(一个戴红眼镜的光头),脑袋全被切掉了,只剩下一个身子和下巴。

因为在大多数构图里,人的头都是偏上的。居中裁剪,正好把头切没了。

解法:我改写了裁剪算法,叫"顶部加权裁剪"。

简单说就是:如果要切掉多余的部分,优先切脚,别切头。

代码里保留了画面顶部 20% 的区域不动,剩下的再进行适配。

这一个小改动,让"废片率"直接降到了 0。

坑三:图片太大

AI 生成的原图通常是 PNG 格式,一张 5MB 甚至 10MB。

我用的 Obsidian 插件在上传这些图到图床时,卡得像是在拨号上网。而且,几兆的图放在文章里,读者加载也慢。

解法:我接入了 TinyPNG 的 API。

它做的是"有损量化压缩",听起来好像画质变差了,但实际上肉眼几乎看不出区别。

一张 5MB 的封面,经过它处理后变成 300KB,但像素不变,清晰度在手机上看完全够用。

坑四:封面只做一张不够

微信公众号的封面有个坑:

主封面是 2.35:1 的宽屏比例,但当文章被转发到朋友圈或群聊时,右侧会显示一个正方形的缩略图。

如果你只做一张 2.35:1 的封面,转发时要么被裁得面目全非,要么留白一大块。

所以现在的流程会分别生成两张封面:一张 2.35:1 的主封面,一张 1:1 的缩略封面,最后拼接在一起。

这个细节,不踩一次坑真的想不到。

为什么这么折腾?因为免费

看到这里你可能会问:搞这么复杂干嘛?直接接一个收费的生图 API 不就完了?

确实,如果我愿意付费,很多问题根本不存在。收费模型的参数传递、比例控制都很成熟,直接调用就行。

但我就是不想在生图环节额外花钱。

我用的是 Antigravity 这个工具,它可以转接免费的 API 额度。只要你是 AI Pro 会员,就能调用里面的生图模型。之前我用它跑写作 Skill,现在生图 Skill 也接进去了。

一套(学生)会员,写作 + 生图都能用,不用额外付费。

代价就是:免费模型没那么"听话",所以才需要在代码层做各种兜底——动态模型路由、顶部加权裁剪、TinyPNG 压缩……

免费,是这套流程的核心吸引点。 上面那些坑,都是为了"免费"而踩的。

一点感想

这次折腾让我对"AI Agent"有了更具体的理解。

以前我觉得 Agent 就是"更聪明的聊天机器人"。

现在我觉得,Agent 是"大脑",而代码是"手脚"。

Agent 负责审美、负责理解情绪、负责设计分镜:这些是不确定的、感性的。

代码负责裁剪比例、压缩图片、上传文件:这些是确定的、刚性的。

最好的 AI 应用,不是把所有事都丢给大模型去"悟",而是用最硬的代码,去兜住最软的创意。

就像那个"顶部加权裁剪"的算法,只有几行代码,但它比任何 Prompt 都能保证我的主角有脑袋。

从"半自动"到"全自动",看起来只是省了几步复制粘贴。但对我来说,省掉的是心流的断裂。

现在配合上受够了复制粘贴,我把 Obsidian 直接接进了微信后台这个 Obsidian 的插件,我的写作流真的无比丝滑了。

如果你对这套生图的 Skill 也感兴趣,欢迎链接一起交流:linauwawa